결론: ChatGPT는 검색엔진이 아닌 언어 모델이며, 구글 순위와 인용 상관관계가 12%에 불과하다

ChatGPT는 기본적으로 학습된 지식을 바탕으로 답변을 생성하는 언어 모델이다. Perplexity가 실시간 웹 검색, Gemini가 구글 색인을 기반으로 하는 것과 근본적으로 다르다. ChatGPT가 인용하는 URL 중 구글 상위 10위에 해당하는 것은 12%에 불과하고, 80%의 인용 URL은 구글 상위 100위에도 들지 않는다. 구글에서 오가닉 가시성이 제로인 페이지의 28.3%가 ChatGPT에 의해 인용되고 있다.

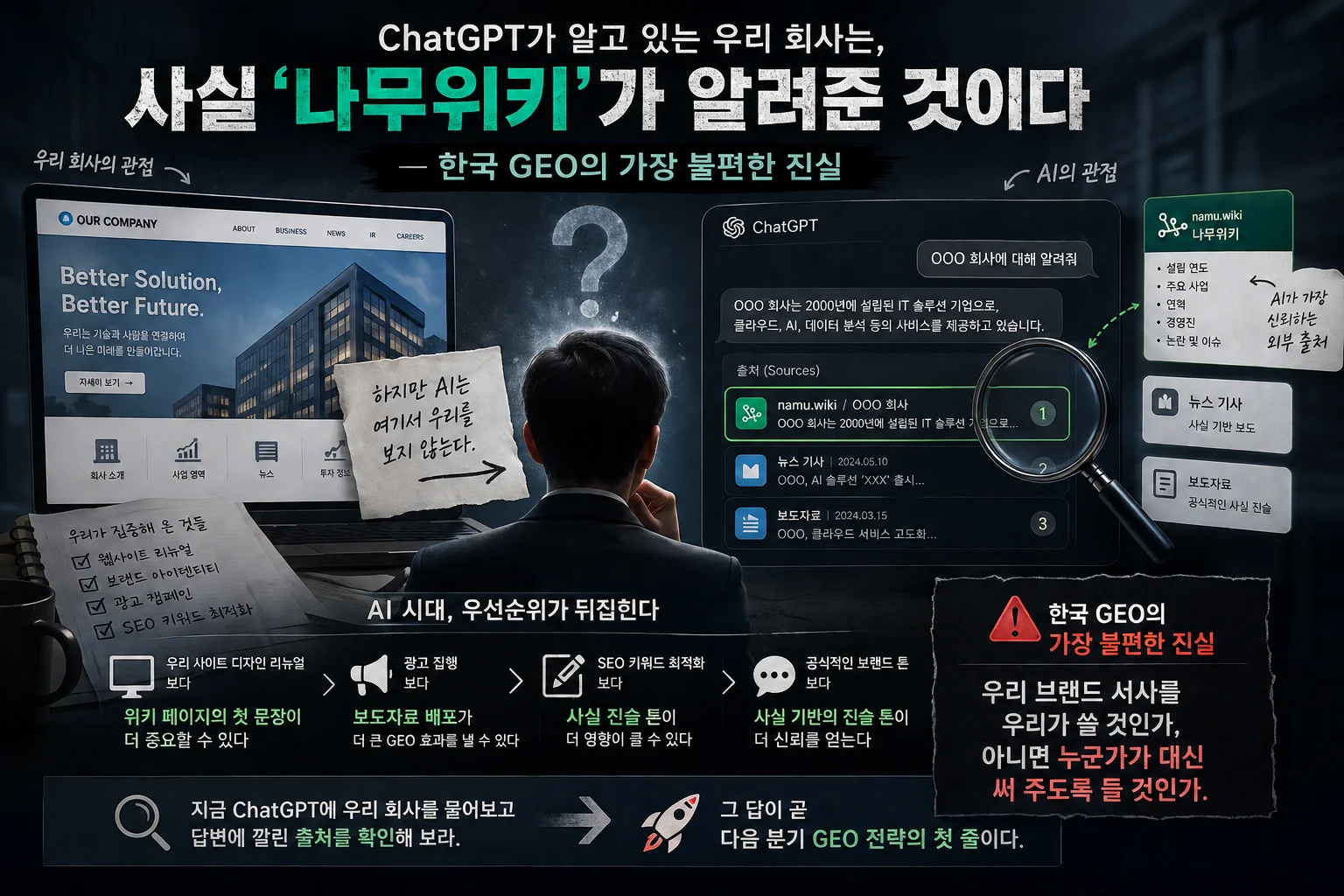

ChatGPT에서 인용되려면 SEO와는 별개의 전략이 필요하다. 핵심은 ①논리적 설명 구조, ②구체적 수치와 데이터, ③독자적 관점, ④웹 전반에서의 브랜드 존재감, ⑤자연스러운 문맥이다. 검색 순위가 아니라, 모델이 학습 과정에서 당신의 콘텐츠를 얼마나 "이해하고 흡수했는가"가 인용을 결정한다.

근거 1: ChatGPT의 이중 경로 — 학습 기반과 검색 기반

학습 데이터 기반 응답. ChatGPT는 방대한 웹 데이터를 학습한 모델이다. 특정 URL을 실시간으로 참조하는 것이 아니라, 학습 과정에서 흡수한 패턴을 기반으로 답변을 생성한다. 웹 전반에서 당신의 브랜드가 자주, 일관되게, 다양한 맥락에서 언급되어야 학습 데이터에 "패턴"으로 각인된다. 업계 매체 기고, 리뷰 사이트 등록, 소셜 미디어 언급 등의 누적이 핵심이다.

ChatGPT Search 기반 응답. 2024년 말 출시된 검색 기능이 활성화되면 웹에서 실시간으로 정보를 가져온다. 가장 많이 인용하는 출처 유형은 위키피디아(47.9%), 뉴스 사이트, 교육 기관 순이다. 신뢰도가 높은 출처를 Perplexity보다 더 강하게 선호하는 경향이 있다.

근거 2: 구글 순위와 ChatGPT 인용의 괴리 — 데이터

Ahrefs의 2025년 8월 연구에 따르면, ChatGPT 인용 URL 중 구글 상위 10위에 해당하는 것은 12%에 불과하다. Google AI Overview가 76%인 것과 비교하면 극적인 차이다. 구글 1위 페이지가 ChatGPT에 인용될 확률도 43.2%에 불과하며, 절반 이상의 구글 1위 페이지가 ChatGPT에서는 선택되지 않는다.

반면, 구글에서 전혀 검색되지 않던 페이지의 28.3%가 ChatGPT에 의해 인용되고 있다. 구글에서 보이지 않더라도, 특정 질문에 대해 독자적이고 구체적인 답변을 제공하는 콘텐츠는 ChatGPT에서 핵심 출처로 활용될 수 있다는 뜻이다.

근거 3: ChatGPT가 선호하는 콘텐츠의 5가지 특성

특성 1 — 설명 가능한 구조. ChatGPT는 정보를 "재구성"해서 답변을 만든다. 개념→설명→예시, 또는 문제→원인→해결 같은 논리적 흐름을 갖춘 콘텐츠가 활용되기 쉽다. 단순 정보 나열보다 "왜 그런가?"를 설명하는 콘텐츠가 유리하다.

특성 2 — 구체적이고 인용 가능한 데이터. "시장이 성장하고 있다"는 인용 가치가 없다. "ChatGPT 주간 활성 사용자가 8억 명을 넘겼다"는 그 자체로 답변에 활용할 수 있는 데이터 포인트다.

특성 3 — 독자적 관점과 원본 정보. 동일한 정보가 100개 사이트에 있으면 ChatGPT는 이를 "일반 상식"으로 처리한다. 특정 사이트에만 있는 독자적 분석, 자체 조사 데이터가 있으면 해당 출처를 명시적으로 인용할 수밖에 없다.

특성 4 — 웹 전반에서의 브랜드 존재감. 학습 기반 응답에서 브랜드가 언급되려면 자사 블로그를 넘어 업계 매체, 인터뷰, 리뷰 사이트, 디렉토리, 파트너 사이트 등 외부 노출이 체계적으로 확대되어야 한다.

특성 5 — 일관되고 자연스러운 문맥. ChatGPT는 키워드 반복이 아니라 문맥을 이해한다. SEO를 위해 키워드를 억지로 삽입한 글, 문맥 없이 정보를 나열한 글은 ChatGPT가 무시한다.

실행 체크리스트

1. 콘텐츠 구조: 논리적 흐름이 갖춰져 있는가? 첫 200단어 안에 핵심 답변이 있는가? H2 제목이 사용자 질문 형태인가?

2. 정보 밀도: 모든 주장에 구체적 수치·출처가 있는가? 독자적 데이터·관점이 포함되어 있는가?

3. 외부 가시성: 업계 매체, 리뷰 사이트, 디렉토리에서 브랜드가 언급되고 있는가?

4. 기술 구조: Article 스키마, 작성자 정보, 발행일이 명시되어 있는가?

5. 최신성: 핵심 콘텐츠가 정기적으로 업데이트되고 있는가?

주의사항

ChatGPT 학습 기반 응답에서의 브랜드 인지도는 단기간에 만들어지지 않는다. 외부 언급을 지속적으로 축적하고, 독자적 콘텐츠를 꾸준히 발행하는 장기 전략이 필요하다.

ChatGPT만을 타깃으로 삼지 마라. 각 AI 플랫폼의 콘텐츠 선택 기준이 다르기 때문에, 복수 플랫폼을 아우르는 GEO 전략이 효과적이다.

기존 SEO를 포기하면 안 된다. ChatGPT에서의 인용과 구글 순위의 상관관계가 낮다고 해서 SEO가 불필요한 것은 아니다. Google AI Overview에서는 여전히 기존 순위와의 상관관계가 76%이며, SEO는 모든 AI 플랫폼에서의 발견 가능성의 기반이 된다.

출처 및 참고 데이터

Ahrefs (2025.08) — ChatGPT 인용 URL 중 구글 상위 10위 해당 비율 12%, 구글 비노출 페이지 인용 비율 28.3%, 구글 1위 페이지 ChatGPT 인용 확률 43.2%.

ChatGPT Search 인용 분석 — 최다 인용 출처 위키피디아(47.9%), 뉴스 사이트, 교육 기관 순.

OpenAI 공식 데이터 — ChatGPT 주간 활성 사용자 8억 명, 전 세계 검색 트래픽의 약 20%.

이 글은 Lumiscan에서 발행되었습니다. ChatGPT를 포함한 AI 검색에서의 가시성을 확인하려면 Lumiscan GEO 진단을 이용해보세요.