한 줄 결론부터

한국에서 ChatGPT에 회사·대학·공공기관을 물으면, 답의 출처는 공식 홈페이지가 아니다. 십중팔구 나무위키, 일부 커뮤니티, 그리고 누가 쓴 지도 모를 블로그다. 우리는 수억 원을 들여 공식 사이트를 만들었지만, AI 시대의 브랜드 서사는 위키 자원봉사자에게 넘어가 있다.

이건 감각적 비유가 아니라 데이터다. 그리고 그 데이터를 받아들이는 순간, GEO(Generative Engine Optimization) 전략의 출발점 자체가 달라진다.

1. 글로벌 사실: ChatGPT는 Wikipedia를 압도적으로 사랑한다

AI 가시성 분석 도구 Profound가 2024년 8월부터 2025년 6월까지 약 6억 8천만 건의 AI 인용을 분석한 결과, ChatGPT의 Top 10 인용 출처 중 Wikipedia가 47.9%를 차지했다. 두 번째인 Reddit(11.3%)의 4배가 넘는다.

이건 일회성 통계가 아니다. Profound가 2025년 10–12월에 미국 영어권 사용자 약 70만 건 대화를 추가 분석했을 때도, ChatGPT가 출처를 인용한 대화의 약 1/6(16.6%)에 Wikipedia가 등장했다. Profound가 보고서에서 도달한 결론은 이 한 줄로 요약된다.

"Wikipedia는 ChatGPT의 기본 지식 레이어다. 이기려 하지 말고, 그 다음 자리를 차지하라."

— Profound, "How ChatGPT sources the web" (2026.2)

또 다른 측정에서도 결과는 일관된다. e커머스 AI 가시성 분석 회사 Azoma는 ChatGPT 인용의 43%가 Wikipedia에서 나온다고 보고했고, Cybernews가 정리한 Profound 데이터에서도 같은 47.9% 수치가 재확인된다. 측정 방법이 달라도 결론은 같다 — ChatGPT는 Wikipedia를 '진실의 기준선'으로 쓴다.

한 가지만 짚고 넘어가자. Google AI Mode에서 Wikipedia 인용은 약 2%, Perplexity에서는 0.8%에 불과하다. Wikipedia 의존은 ChatGPT의 고유한 특성이다. 즉, 이 글에서 다루는 문제는 ChatGPT 한정이지만, 한국에서 AI 검색 점유율의 절대다수가 ChatGPT라는 점을 감안하면 사실상 시장 전체의 문제다.

2. 한국의 상황은 더 비대칭적이다

여기까지는 영어권 데이터다. 한국은 더 심각하다. 두 가지 구조적 이유가 겹쳐 있다.

이유 1. GPT 학습 데이터의 한국어 비중은 0.19%다

OpenAI가 GPT-3 학습에 사용한 데이터를 언어별로 분석한 논문(Brown et al., 2020)에 따르면, 영어 데이터가 92.64%, 한국어는 0.19%다. 국립중앙도서관의 '월드라이브러리' 자료에서도 동일한 수치가 인용된다. 즉 GPT는 처음부터 한국어 정보가 거의 없는 상태로 태어났다. 이후 모델이 발전하면서 보강은 되었지만, 학습 데이터의 비대칭은 아직도 유효하다.

그럼 ChatGPT가 한국 정보를 답할 때 무엇에 의존하는가? 두 가지다.

학습 단계에서 본 Wikipedia 영문판의 한국 관련 항목

실시간 검색(Browsing)을 켰을 때 크롤링 가능한 한국어 사이트

이유 2. 그런데 한국 정보 1위 플랫폼인 네이버는 AI 봇을 차단했다

2025년 5월, 네이버는 블로그·카페·지식인의 robots.txt에 다음 문구를 명시했다.

BOT ACCESS FOR THE PURPOSES OF AI TRAINING AND RETRIEVAL-AUGMENTED GENERATION (RAG) IS STRICTLY PROHIBITED.

전자신문의 보도와 inblog.ai의 분석에 따르면, 이 조치로 blog.naver.com·cafe.naver.com·kin.naver.com의 모든 콘텐츠가 GPTBot, PerplexityBot, Google-Extended에서 완전히 차단되었다. 한국 B2B 기업의 41%가 네이버를 주요 마케팅 채널로 활용해 온 상황에서, 그동안 누적된 콘텐츠 자산이 글로벌 AI 답변에서 한 번에 증발한 셈이다.

나무위키 자체 ChatGPT 항목이 이 상황을 정확히 진단한다. "네이버는 사실상 세계 인터넷에서 격리되어 있다. 때문에 ChatGPT는 알고리즘의 성능을 떠나 한국에 대한 제대로 된 정보 수집이 불가능하다." 흥미롭게도 이 문장 자체가 ChatGPT가 한국 IT 생태계를 설명할 때 인용할 가능성이 가장 높은 문장이다.

3. 그래서 그 빈자리를 누가 채우는가

학습 데이터에서 한국어 비중이 0.19%이고, 한국 정보의 메인 저장소인 네이버가 차단되어 있다. 그럼 ChatGPT가 한국 회사·대학·기관을 답할 때 어디에서 그 정보를 가져오는가?

크롤링이 열려 있고, 위키 형식이며, 단일 주제·단일 페이지로 정리되어 있는 곳들이다. 구체적으로 세 군데가 그 자리를 차지한다.

유형 | 대표 사이트 | 특성 | AI 인용 우선순위 |

|---|---|---|---|

위키형 | 나무위키, 한국어 위키백과 | 크롤링 허용, 단일 주제 정리, 인용 가능 | 매우 높음 |

커뮤니티 | everytime, 디시인사이드 | 실사용자 후기, 의견, 평판 | 높음 (특히 대학·서비스) |

구글 인덱스 블로그 | 티스토리, 브런치, 워드프레스 | 네이버와 달리 크롤링 허용 | 중간 |

루미스캔 블로그 4월 21일 자 컬럼 〈AI 인용률 100%인데 GEO 점수는 49점〉에서 다룬 성균관대 케이스가 정확히 이 패턴이다. 5,089개 공식 페이지가 있는 대학교 사이트가, AI 답변에서는 everytime·나무위키·한국어 위키에 자리를 내주고 있다. 인용률 자체는 높은데 답변 우선순위·AI 이해도가 경쟁사 평균보다 40점 이상 낮다. '말은 걸지만, 핵심은 다른 곳에서 들고 온다'는 뜻이다.

4. 왜 이런 일이 벌어지는가 — 4가지 구조적 이유

"공식 사이트가 더 권위 있는데 왜 위키가 이기는가"라는 질문에는 네 개의 구조적 답이 있다.

① 위키는 LLM이 학습 단계에서부터 본 콘텐츠다

Common Crawl과 Wikipedia 덤프는 거의 모든 LLM의 사전학습 데이터에 포함된다. 학습 시점부터 모델 가중치에 새겨진 정보는, 추론 시점에 검색으로 가져온 정보보다 답변에 등장할 확률이 본질적으로 높다.

② 위키는 '인용 가능한 단위'로 구조화되어 있다

한 주제에 한 페이지, 명사로 시작하는 정의문, 출처 각주, 짧은 단락 — LLM이 가장 잘 처리하는 형식이다. 반대로 공식 사이트는 메뉴 깊이, 동적 렌더링, 분산된 콘텐츠, 여러 페이지에 걸친 서사 구조다. 같은 정보라도 LLM이 '뽑아낼 수 있는 형태'가 아니다.

③ 외부 백링크 권위에서 위키가 압도한다

한국어 위키백과·나무위키는 도메인 권위가 매우 높다. 백링크 수, 다른 사이트의 인용 빈도, 검색엔진 순위 — 모든 권위 신호에서 일반 기업 사이트를 압도한다. AI는 이 권위 신호를 '신뢰할 만한 출처'의 1차 필터로 쓴다.

④ 공식 사이트는 자기 자랑을, 위키는 사실 진술을 한다

이게 가장 본질적이다. 기업·대학·공공기관 공식 사이트는 마케팅 톤으로 작성된다. "혁신적인", "최고의", "차별화된" — LLM은 이런 형용사를 권위 신호로 받아들이지 않는다. 반대로 위키는 "X는 1995년 설립된 Y이다" 형태의 사실 서술을 쓴다. LLM에게 '진실'은 형용사가 아니라 술어로 표현된다.

5. 2025년 9월의 충격 — Wikipedia 의존이 급락하면 무슨 일이 벌어지나

2025년 9월, 흥미로운 사건이 있었다. Semrush가 13주간 23만 건 이상의 프롬프트를 분석한 결과, ChatGPT 응답에서 Wikipedia가 등장하는 비율이 약 55%에서 20% 미만으로 급락했다. 같은 시기 Reddit 인용도 함께 떨어졌다.

SEO 업계는 즉시 두 가지 가설을 던졌다. 구글이 검색 결과 API에서 num=100 파라미터를 제거한 사건이 영향을 줬다는 설과, ChatGPT가 특정 도메인 의존을 의도적으로 줄였다는 설. 어느 쪽이든 시사점은 같다.

AI의 인용 패턴은 한 분기 만에도 절반으로 흔들린다. Wikipedia만 잡고 안주할 수 없다는 뜻이다. 그리고 흔들린 자리를 무엇이 채웠는가 — Forbes, LinkedIn 같은 권위 매체의 인용이 같은 시점에 늘었다. 인용 경제는 위키 다음으로 누가 '믿을 만한 외부 출처'가 될 것인가를 두고 재편되고 있다.

6. 그래서 지금 당장 해야 할 일 — 5단계

여기서부터는 실행 가이드다. 추상적이지 않게, 이번 주 안에 시작할 수 있는 일만 적었다.

1단계. 우리 회사·기관의 위키 페이지를 점검한다 (소요 시간 30분)

한국어 위키백과와 나무위키에서 우리 조직의 항목을 검색한다. 페이지가 없거나, 사실이 틀리거나, 오래된 정보가 박혀 있다면 그것이 곧 AI가 우리를 설명하는 방식이다. 영문 위키백과까지 함께 본다 — ChatGPT는 영문판 가중치가 더 높다.

2단계. 사실 오류는 '자원봉사자 정정 절차'를 따라 고친다

위키백과는 출처가 명시된 보도자료·논문·정부 문서를 근거로 누구나 편집 가능하다. 나무위키는 토론 페이지에서 근거를 제시하면 수정 가능하다. 단 홍보성 표현·자체 사이트만 출처로 쓰는 편집은 즉시 되돌려진다. 기준은 외부에 인용 가능한 3차 출처가 있는가이다.

3단계. 공식 사이트 핵심 페이지를 'Wiki-style'로 재구조화한다

About 페이지, 서비스 소개, 학과 소개, 사업 안내 — 이 페이지들을 다음 형식으로 다시 쓴다.

첫 문장은 정의문: "X는 ~인 Y이다"

핵심 사실은 짧은 단락 단위, 한 단락에 한 사실

구체적 숫자·연도·출처를 본문에 박아 넣는다

FAQ 섹션을 별도로 두고, 각 답변은 50–150자로 끊는다

4단계. 외부 권위 출처를 의도적으로 만든다

공식 사이트만 갱신해서는 권위 신호가 부족하다. 보도자료를 정기 배포하고, 업계 미디어 기고를 쓰고, 정부·협회 통계나 보고서에 우리 조직이 등장하는 빈도를 늘려야 한다. 네이버 블로그가 차단된 지금, 티스토리·브런치·LinkedIn·자체 블로그가 한국어 백링크의 대체 자산이다.

5단계. AI 인용을 일상적으로 모니터링한다

월 1회, ChatGPT·Perplexity·Claude·Google AI Mode에 우리 조직과 핵심 키워드를 직접 물어본다. 답변에 등장하는 출처를 기록하고, 사실 오류·누락·경쟁사 우위를 추적한다. AI 시대의 브랜드 모니터링은 검색 순위 추적이 아니라 AI 답변 추적이다.

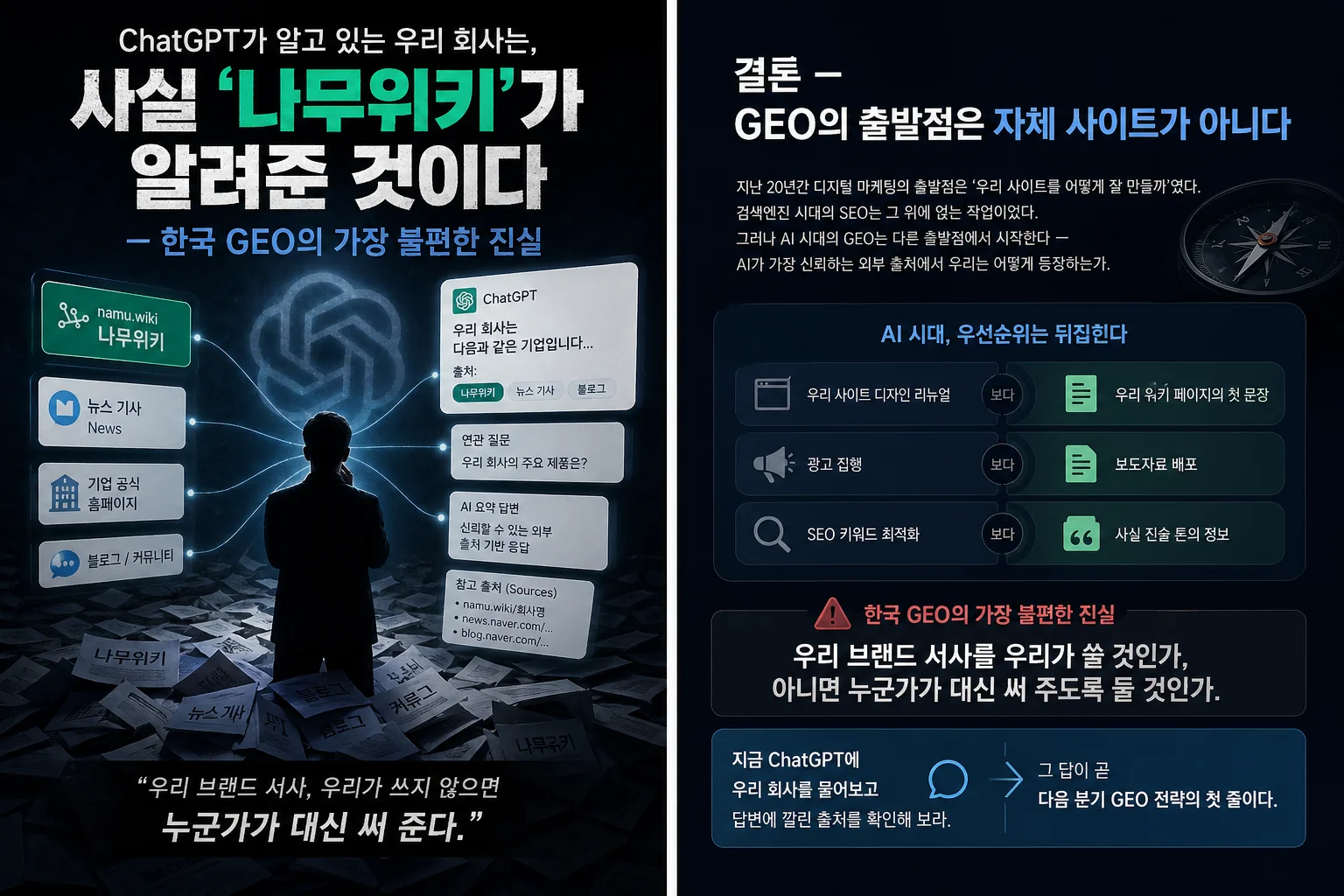

7. 결론 — GEO의 출발점은 자체 사이트가 아니다

지난 20년간 디지털 마케팅의 출발점은 '우리 사이트를 어떻게 잘 만들까'였다. 검색엔진 시대의 SEO는 그 위에 얹는 작업이었다. 그러나 AI 시대의 GEO는 다른 출발점에서 시작한다 — AI가 가장 신뢰하는 외부 출처에서 우리는 어떻게 등장하는가.

이 질문 앞에 서면 우선순위가 뒤집힌다. 우리 사이트의 디자인 리뉴얼보다, 우리에 대한 위키 페이지의 첫 문장이 더 중요할 수 있다. 보도자료 배포가 광고 집행보다 더 큰 GEO 효과를 낼 수 있다. 공식 톤을 버리고 사실 진술 톤으로 바꾸는 것이 SEO 키워드 최적화보다 더 영향이 클 수 있다.

한국 GEO의 가장 불편한 진실은 이것이다. 우리 브랜드 서사를 우리가 쓸 것인가, 아니면 누군가가 대신 써 주도록 둘 것인가. 지금 ChatGPT에 우리 회사를 물어보고 답변에 깔린 출처를 확인해 보라. 그 답이 곧 다음 분기 GEO 전략의 첫 줄이다.

주의사항

인용 비중은 변동한다. Wikipedia 47.9%는 Profound의 Top 10 기준이며, 전체 인용 기준으로는 7.8%다. Semrush는 2025년 9월 ChatGPT의 Wikipedia 의존이 급락한 사례를 보고했다. 단일 시점의 비율보다 패턴 자체에 주목해야 한다.

모든 LLM이 같지 않다. Wikipedia 의존은 ChatGPT 특유의 패턴이다. Perplexity는 Reddit·G2 비중이 높고, Google AI Mode는 YouTube·Reddit·Google 자체 자산을 우선한다. 멀티 플랫폼 GEO 전략이 필요하다.

한국 LLM은 별도 분석이 필요하다. 네이버 AI 브리핑, 카카오 AI 등은 자사 콘텐츠 자산 비중이 다르다. 이 글은 ChatGPT·Perplexity·Claude 같은 글로벌 LLM에 한정된 분석이다.

위키 편집은 자정 작업이지, 마케팅이 아니다. 홍보성 편집은 즉시 되돌려지고, 반복되면 계정·IP가 차단된다. 외부 출처가 명시된 사실 정정만 가능하다.

네이버 차단은 글로벌 LLM 한정이다. 네이버 검색·네이버 AI 내부에서는 네이버 콘텐츠가 여전히 작동한다. 국내 검색 트래픽을 위한 네이버 운영과, 글로벌 AI 노출을 위한 외부 채널 운영을 분리해 가져가야 한다.

출처

Profound, "AI Platform Citation Patterns" (2025.6, 680M citations 분석) — https://www.tryprofound.com/blog/ai-platform-citation-patterns

Profound, "How ChatGPT sources the web" (2026.2, 700K conversations 분석) — https://www.tryprofound.com/blog/chatgpt-citation-sources

Semrush, "The Most-Cited Domains in AI: A 3-Month Study" (2025.11, 230,000+ prompts 분석) — https://www.semrush.com/blog/most-cited-domains-ai/

Azoma, "The Sources ChatGPT and Google AI Overviews cite the most" (2025.8) — https://www.azoma.ai/insights/the-sources-chatgpt-cites-the-most-per-query-type

Brown, T. et al., "Language Models are Few-Shot Learners" (2020) — GPT-3 학습 데이터 언어 분포

국립중앙도서관, "생성 AI의 학습데이터와 도서관의 역할" — https://librarian.nl.go.kr

인블로그, "네이버 블로그, 앞으로 AI 검색엔진에서 못 본다?" (2025.7) — https://inblog.ai/ko/blog/naver-blog-robots-txt

전자신문, "네이버, 구글 등 AI 봇 크롤링 차단" (2025.7) — https://v.daum.net/v/20250716143440337

나무위키, "ChatGPT" 항목 — 한국어 학습 데이터 0.19% 통계 인용

루미스캔 블로그, "AI 인용률 100%인데 GEO 점수는 49점" (2026.4.21) — lumiscan.live

이 글은 루미스캔(LumiScan)이 발행하는 GEO 컬럼 시리즈의 일부입니다. 루미스캔은 한국어 사이트의 AI 검색 노출을 진단하고, ChatGPT·Claude·Perplexity·Gemini에서 우리 브랜드가 어떻게 등장하는지 측정하는 GEO 분석 플랫폼입니다.